За його словами, людство стоїть на порозі нової ери, в якій перетинаються одразу три глобальні загрози.

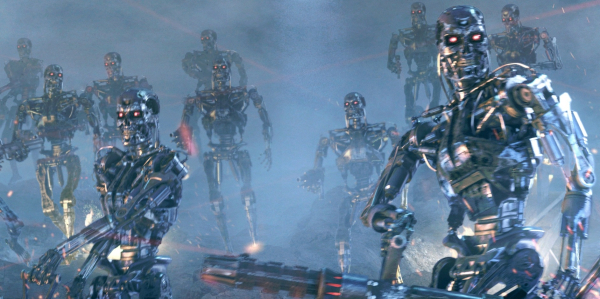

Оскароносний режисер Джеймс Кемерон, автор «Аватара» та «Термінатора», знову про загрозу, яку може становити штучний інтелект. В інтерв'ю Rolling Stone він заявив, що об'єднання ІІ із системами озброєнь, особливо ядерних, може призвести до катастрофічних наслідків.

Існує реальна загроза апокаліпсису за сценарієм Термінатора, якщо об'єднати ІІ зі зброєю, аж до ядерних систем. Все відбувається надто швидко, рішення потрібно приймати миттєво, і лише суперінтелект може впоратися з таким обсягом даних.

Джеймс Кемерон

Режисер

Кемерон додав, що хоча людина залишається в ланцюжку прийняття рішень, історія знає чимало помилок, які ледь не призвели до ядерної війни. За його словами, людство стоїть на порозі нової ери, в якій перетинаються одразу три глобальні загрози: кліматична криза, ядерна зброя та суперінтелект. «Можливо, саме суперінтелект стане вирішенням усіх проблем. Я не стверджую цього, але й не виключаю», – сказав він.

Кемерон також знову зазначив, що не вірить у здатність ІІ створювати по-справжньому добрі історії. Ще в 2023 році він різко висловився про ідею використовувати нейромережі для написання сценаріїв: «Це просто словесний салат із чужих почуттів та переживань. Щоб зачепити глядача, потрібно бути людиною».

Проте, режисер бачить потенціал ІІ зниження вартості виробництва блокбастерів. У 2024 році він увійшов до ради директорів Stability AI – компанії, що стоїть за моделлю Stable Diffusion. На подкасті Boz to the Future він заявив, що майбутнє кіно залежить від здешевлення візуальних ефектів: «Якщо ми хочемо продовжувати робити та дивитися такі фільми, як „Дюна“ чи мої стрічки, потрібно скоротити вартість спецефектів удвічі. Не звільняючи співробітників, а пришвидшуючи їхню роботу».